Il y a trois sujets :

- est-ce qu'on entraîner des modèles d'IA sur des données copyrightées ?

- est-ce qu'on peut mettre à disposition ledit modèle ?

- est-ce que les sorties du modèle sont soumis à copyright ?

Pour 1, il me semble que la réponse est devrait être oui sous réserve que les données aient été acquises/consultées de façon légale. Par exemple, je devrais le droit d'entraîner un modèle qui génère des échantillons de voix de John Travolta à partir de mon exemplaire Blu-ray de Pulp Fiction.

En revanche, c'est moins clair pour 2. Le statut légal des paramètres des modèles de machine learning n'est pas clair du tout. Quand les paramètres sont distribués publiquement, c'est généralement avec une licence d'utilisation similaire à celles que l'on trouve pour les logiciels. Mais, à ma connaissance, la validité de ces licences n'a jamais été questionnée en justice, ni aux États-Unis ni en Europe. Le consensus (mou et peu informé) chez les universitaires est que les paramètres du modèle héritent des droits d'utilisation du jeu de données. Autrement dit : si mes données sont libres de droit, alors les paramètres aussi. Si mes données sont sous copyright, là c'est plus touchy. Les entreprises, elles, ne distribuent en général pas les paramètres du modèle, elles se content de vendre un service pour dépendre du point n°3.

Et donc pour terminer, sur le point 3, et bien ça dépend. La justice américaine a pour l'instant tranché qu'une image générée par IA ne pouvait pas être protégée par le droit d'auteur, sauf si elle a significativement été altérée par un humain. Néanmoins, une sortie peut quand même violer le droit d'auteur : si Dall-E génère une image de Mario, c'est bel et bien un personnage dont l'apparence est détenue par Nintendo. C'est bien entendu pire que ça en réalité puisqu'en pratique les générateurs recrachent parfois des images de leur corpus d'entraînement presque sans modification. Donc le modèle peut reproduire des images sous copyright si elles étaient dans le dataset. Pour l'instant, Midjourney/OpenAI/Stability avancent les arguments suivants (avec les contre-arguments avancés) :

- c'est de la responsabilité de l'utilisateur, s'il ne redistribue pas cette image et n'en fait qu'un usage privé, quel problème ? -> c'est bien le fournisseur de service qui redistribue une image sous copyright, c'est donc sa responsabilité qui est engagée avant celle de l'utilisateur.

- ça n'arrivera plus, on va empêcher les modèles de recracher des exemples issus du jeu d'apprentissage -> pour l'instant on ne sait pas faire ça techniquement.

- ça n'arrivera plus, on va censurer les modèles pour empêcher les utilisateurs de produire du contenu copyrighté -> aucune des contre-mesures déployées actuellement ne fonctionne.

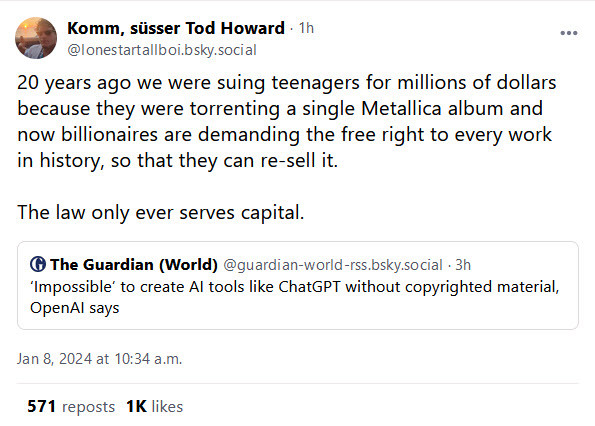

- ça n'arrivera plus, on va changer les jeux de données pour enlever tout ce qui est sous copyright -> c'est ce qu'a essayé Adobe avec Firefly et ça ne marche pas très bien, en plus en se limitant aux données libres de droit, on n'arrivera pas à entraîner des générateurs aussi bons.

À mon avis, c'est un bourbier juridique dans lequel ces boîtes se sont engagées. Les plus petites startups (Midjourney et Stability notamment) ont pris énormément de risques en se basant sur le corpus LAION, dont la provenance était légalement floue. À l'origine, ce jeu de données était plutôt prévu pour être utilisé par des universitaires, les exceptions au copyright étant assez souples pour la recherche scientifique. Maintenant, ils vont payer les pots cassés. Je doute que les ayants-droits lâchent le morceau : si les chiffres qui circulent sur Internet sont vrais (OpenAI proposerait environ 1M$ aux journaux/sites web pour une licence d'utilisation de leurs articles), il y a peu de chances que les grands médias acceptent de négocier un deal. C'est aussi une raison pour laquelle la génération musicale est encore hésitante : les majors du disque et du streaming seront bien plus agressifs que la presse et les arts graphiques. Chez les studios de jeux vidéo et de cinéma, ces questions de licence sont encore un frein majeur à l'adoption des techniques génératives. Personne n'a envie de se prendre un procès pour violation de droit d'auteur et plagiat parce qu'un asset de la Pat'patrouille s'est retrouvé par mégarde dans le charadesign du nouveau Star Wars.